OpenAI, i memo segreti contro Altman: "Mente, manipola, non può decidere sul futuro dell'umanità"

Un'inchiesta del New Yorker svela dossier interni, testimonianze di ex dirigenti e documenti mai resi pubblici. Il ritratto che emerge è quello di un uomo che piega sicurezza, regole e alleanze ai suoi interessi.

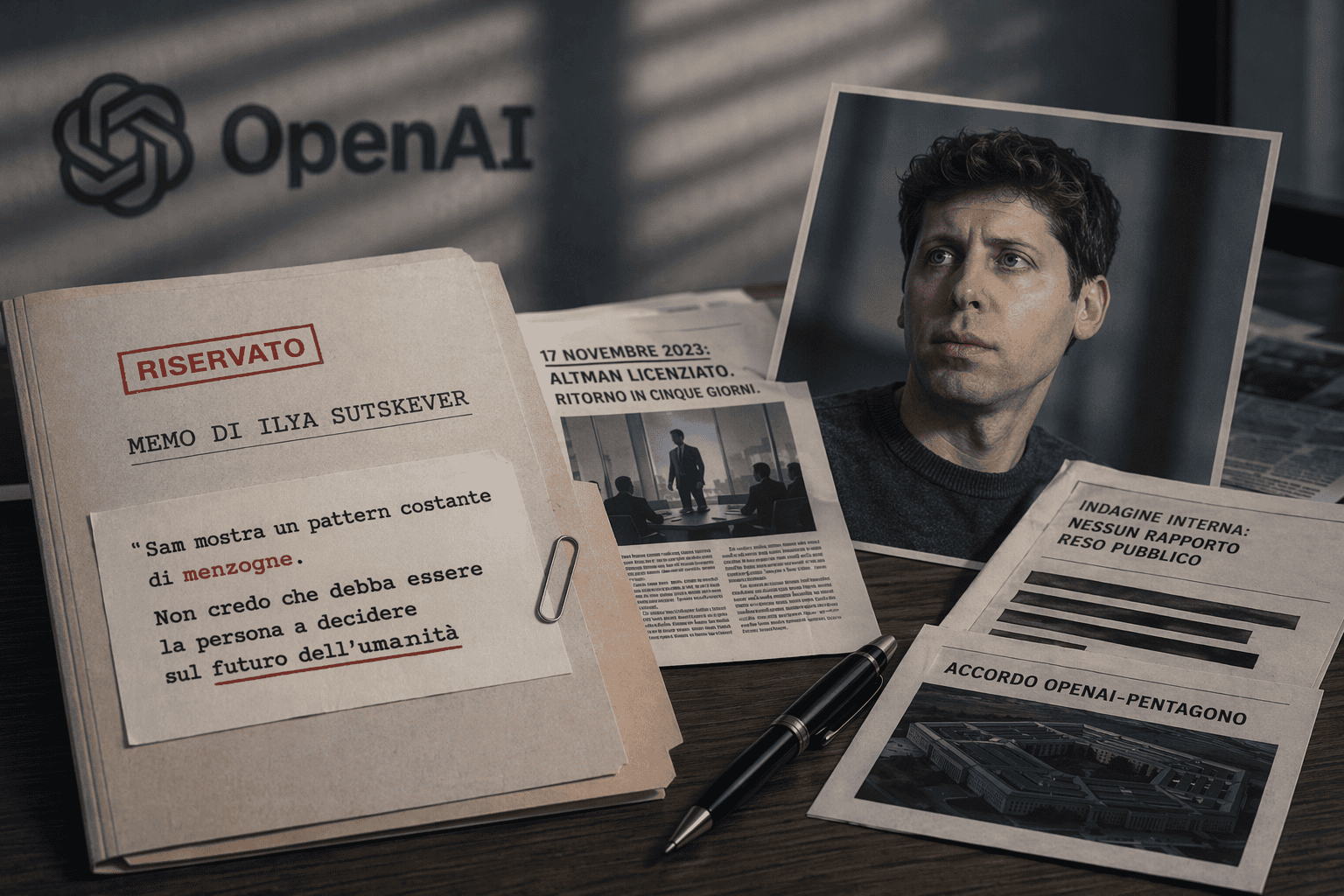

Sam Altman è alla guida di una delle aziende più potenti al mondo, OpenAI, ma i suoi stessi collaboratori storici ora lo ritengono una persona inaffidabile, la cui carriera si è basata su menzogne e manipolazioni. Lo racconta un'inchiesta del New Yorker firmata da Ronan Farrow e Andrew Marantz, costruita su oltre cento interviste e su documenti interni mai resi pubblici tra cui i cosiddetti "memo di Ilya" e gli appunti personali di Dario Amodei, ex dipendente di OpenAI oggi a capo della rivale Anthropic.

Il dossier di Sutskever e il licenziamento del 17 novembre

Nell'autunno del 2023 Ilya Sutskever, all'epoca capo scienziato di OpenAI, inviò ad alcuni membri del Consiglio di Amministrazione un dossier riservato: circa settanta pagine di messaggi Slack, documenti delle risorse umane e testi esplicativi. Uno dei memo si apriva con una lista intitolata "Sam mostra un pattern costante di…" e al primo posto c'era la parola "menzogne". Sutskever disse a un consigliere: "Non credo che Sam sia la persona che debba decidere sul futuro dell'umanità".

Il 17 novembre 2023 il board licenziò Altman. La motivazione ufficiale: non era stato "costantemente sincero nelle sue comunicazioni". Microsoft, che aveva investito circa 13 miliardi di dollari in OpenAI, fu avvisata pochi minuti prima. "Ero sconvolto. Non riuscivo a sapere nulla da nessuno", racconta l'Amministratore Delegato Satya Nadella. Reid Hoffman, cofondatore di LinkedIn, fece una serie di telefonate per capire se Altman avesse commesso qualcosa di preciso: "Cercavamo notizie su appropriazione indebita o molestie sessuali, ma non ho trovato nulla".

Nei giorni successivi, quello che i dipendenti oggi chiamano "the Blip" ("la Svista"), Altman organizzò nella sua villa di San Francisco un "governo in esilio" con legali, investitori e l'esperto di crisi aziendali Chris Lehane. Così si arrivò ad una serie di decisioni chiave per il futuro di OpenAI: il fondo Thrive di Josh Kushner congelò un'operazione da 86 miliardi di dollari, mentre Microsoft annunciò una struttura parallela per accogliere Altman e chi lo avesse seguito.

Nel giro di pochi giorni, anche la maggioranza dei dipendenti di OpenAI minacciò di dimettersi. Il board si ritrovò con le spalle al muro e, in meno di cinque giorni, Altman venne reinsediato, mentre quasi tutti i membri del consiglio fecero un passo indietro. Eppure non era la prima volta che sul suo conto emergevano dubbi. Già negli anni di Y Combinator, l’incubatore di startup che guidò dal 2014, alcuni soci avevano chiesto a Paul Graham di rimuoverlo. Graham, scrive il New Yorker, disse ai colleghi che "Sam ci mentiva continuamente". Da parte sua, Altman ha sempre negato di essere stato licenziato.

La sicurezza messa da parte

Dopo il reintegro, i controlli sulla sicurezza interna si sono progressivamente indeboliti. Al team "superalignment" guidato da Sutskever e Jan Leike era stato promesso il 20% della potenza di calcolo aziendale. Ne ha ricevuto tra l'1 e il 2%, spesso su chip obsoleti. Alla fine il team è stato sciolto. Leike, dopo le dimissioni, ha scritto su X: "La cultura della sicurezza e i processi sono passati in secondo piano rispetto ai prodotti brillanti".

Intanto, l’indagine interna avviata dopo il Blip non ha mai messo nero su bianco una relazione finale. WilmerHale ha fornito soltanto briefing orali ai due nuovi membri del board, Bret Taylor e Lawrence Summers, nominati dopo consultazioni con lo stesso Altman. Sei persone vicine all’indagine sostengono che l’intero processo fosse stato disegnato apposta per ridurre al minimo la trasparenza. Il senso, riassume una fonte, è questo: "L’indagine non ha affatto stabilito che Sam fosse un campione di integrità alla George Washington".

Il Golfo, Stargate e l'accordo col Pentagono

Sul piano politico, Altman ha costruito negli anni una rete di rapporti sempre più stretta con i Paesi del Golfo e con l’Amministrazione Trump. Il progetto ChipCo, poi confluito in Stargate, è il simbolo più evidente di questa strategia: a gennaio 2025 Trump lo ha presentato alla Casa Bianca come un piano da 500 miliardi di dollari per costruire l’infrastruttura dell’intelligenza artificiale negli Stati Uniti, e nei mesi successivi OpenAI ha esteso quel disegno anche agli Emirati, con il lancio di Stargate UAE e il coinvolgimento in un maxi-campus di data center ad Abu Dhabi.

Un ex dirigente di OpenAI ha descritto questa corsa come una gigantesca fuga in avanti: "Stiamo costruendo portali da cui stiamo davvero evocando alieni. I portali esistono negli Stati Uniti e in Cina, e Sam ne ha aggiunto uno in Medio Oriente. È la cosa più sconsiderata mai fatta". Al di là della formula, però, il punto politico è chiaro: senza i suoi legami con l’Amministrazione Trump, per Altman sarebbe stato molto più difficile trasformare un progetto industriale in una piattaforma geopolitica capace di saldare la sua società, la Casa Bianca e le monarchie del Golfo.

La stessa dinamica si è vista nel braccio di ferro tra Anthropic ed il Pentagono. A febbraio 2026 Anthropic ha rifiutato di eliminare dai sistemi Claude i limiti che ne impediscono l’uso per sorveglianza di massa dei cittadini americani e per armi completamente autonome. OpenAI, invece, ha imboccato subito la strada opposta: nel giro di pochi giorni ha chiuso un accordo con il Pentagono per portare i suoi modelli nelle reti classificate e, subito dopo, ha allargato l’operazione con una partnership strategica con Amazon, che prevede anche un investimento fino a 50 miliardi di dollari in OpenAI e la distribuzione della sua tecnologia alle agenzie governative attraverso AWS. Formalmente OpenAI continua a rivendicare alcuni paletti, ma sul piano politico il risultato non cambia: mentre Anthropic veniva isolata, Altman ha convertito la propria vicinanza all’Amministrazione Trump in accesso, contratti e potere.

Il contraccolpo si è però visto sul fronte consumer. Dopo lo scontro con il Pentagono e la scelta di OpenAI di accettare questo compromesso, la rivale Claude ha beneficiato di un netto spostamento di attenzione e di utenti: ha superato ChatGPT nei download sull’App Store statunitense e Anthropic ha dichiarato che gli abbonamenti a pagamento sono più che raddoppiati dall’inizio del 2026. La decisione di Altman ha quindi regalato a Claude un potente vantaggio reputazionale presso una parte degli utenti privati, che hanno letto la linea di Anthropic come più credibile e meno allineata alle richieste dell’Amministrazione Trump.

L'attacco con la molotov e la rabbia contro l'IA

La tensione attorno alla figura di Altman è di recente esplosa anche fuori dai consigli di amministrazione e dal dibattito online. Il 10 aprile 2026, intorno alle 3:45 del mattino, un uomo ha lanciato una molotov contro il cancello della sua casa di San Francisco, provocando un principio d’incendio poi domato senza feriti. L’autore, Daniel Moreno-Gama, 10 anni, residente a Spring, in Texas, è stato arrestato poco dopo davanti alla sede di OpenAI, dove avrebbe minacciato di incendiare l’edificio e fare del male alle persone presenti.

Secondo le autorità, aveva con sé cherosene, altri ordigni incendiari, un’arma non registrata e un manifesto anti-IA con minacce contro Altman e altri esponenti del settore. Moreno-Gama è stato incriminato a livello statale per due capi di tentato omicidio e altri reati, oltre a dover rispondere anche di accuse federali legate agli esplosivi e all’arma. Ma non è finita qui. Due giorni dopo, la stessa abitazione è stata colpita in un secondo episodio: secondo la polizia, un’auto si è fermata davanti alla casa e da lì sarebbe partito almeno un colpo d’arma da fuoco.

Altman ha reagito ai due attacchi contro la sua casa con un post sul suo blog in cui ha pubblicato una foto della sua famiglia e scritto: "Di solito cerchiamo di essere piuttosto riservati, ma in questo caso condivido questa immagine nella speranza che possa dissuadere la prossima persona dal lanciare una molotov contro casa nostra, qualunque cosa si pensi di me". Nello stesso testo ha aggiunto che "la paura e l’ansia per l’IA sono giustificate", ma non possono trasformarsi in violenza.